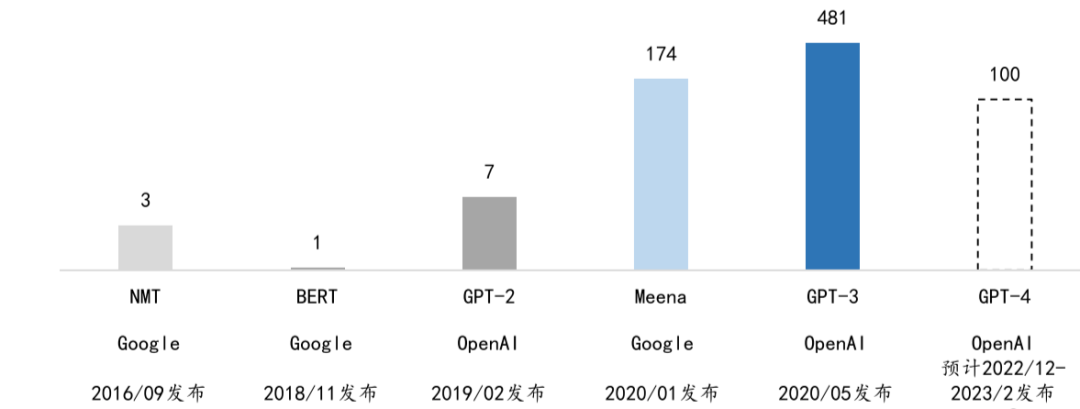

2018年6月,OpenAI推出了第一个GPT模型,它的参数量为1.17亿个,仅仅使用了大规模文本数据进行无监督预训练。该模型使用的是Transformer架构,可以在各种自然语言处理任务中取得出色的表现。

2019年11月,OpenAI推出了第二个GPT模型,称为GPT-2,该模型的参数量高达1.5亿个,可以生成比之前更加复杂、准确、自然的文本。这个模型在推出后引起了广泛的关注和讨论。

2020年6月,OpenAI推出了第三个GPT模型,称为GPT-3,该模型的参数量达到了1.75万亿个,是之前最大规模的语言模型。该模型可以进行各种任务,包括生成文本、语言翻译、问题回答等,并且在某些任务上达到了人类水平的表现。